A inteligência artificial (IA) tem revolucionado a forma como interagimos com a tecnologia, proporcionando ferramentas poderosas para criar conteúdos inovadores. Neste artigo, vou mostrar como é fácil transformar imagens em histórias com IA, criando uma pequena história a partir de uma imagem e convertendo-a em áudio utilizando Python e algumas bibliotecas de IA. O conteúdo deste artigo também está disponível em formato de vídeo

Conteúdo

- 1 O que é IA e como ela pode ser usada para transformar imagens em histórias?

- 2 Imagens em Histórias com IA: Visão Geral do Processo

- 3 Quais são as 3 etapas para criar narrativas sonoras utilizando IA?

- 4 Configuração do Ambiente

- 5 Quais são os benefícios de utilizar IA na criação de narrativas sonoras?

- 6 Quais são os possíveis usos e aplicações da criação de narrativas sonoras com IA?

O que é IA e como ela pode ser usada para transformar imagens em histórias?

IA, ou inteligência artificial, refere-se à capacidade dos sistemas computacionais de realizar tarefas que normalmente requerem inteligência humana. Isso inclui aprendizado, reconhecimento de padrões, resolução de problemas e tomada de decisões. Na transformação de imagens em histórias, a IA analisa o conteúdo visual para gerar descrições textuais, que podem então ser usadas para criar narrativas.

Imagens em Histórias com IA: Visão Geral do Processo

Transformar imagens em histórias com IA envolve um processo estruturado em três etapas principais. Neste artigo, vamos detalhar como cada uma dessas etapas pode ser realizada utilizando ferramentas e bibliotecas de inteligência artificial.

Quais são as 3 etapas para criar narrativas sonoras utilizando IA?

1. Transformar uma imagem em texto utilizando um modelo de visão computacional.

2. Gerar uma história curta a partir do texto extraído usando a API da OpenAI.

3. Converter a história em áudio com a biblioteca gTTS.

Configuração do Ambiente

Primeiro, certifique-se de que você possui o Python instalado em sua máquina. Caso prefira, você pode usar ambientes virtuais ou Anaconda para gerenciar as dependências do projeto. Para desenvolvimento do código, estou utilizando um Mac com a IDE do VSCode.

. Você pode instalar as bibliotecas com o seguinte comando:

pip install transformers langchain-core langchain-openai gtts python-dotenv

Instalando PyTorch

Para usar o modelo Salesforce/blip-image-captioning-base, precisamos do PyTorch. PyTorch é uma biblioteca de aprendizado profundo de código aberto desenvolvida pelo Facebook’s AI Research lab (FAIR). Ela é amplamente utilizada para aplicações de aprendizado de máquina que envolvem processamento de linguagem natural, visão computacional e mais. PyTorch é conhecida por sua flexibilidade e facilidade de uso, oferecendo suporte a cálculos numéricos com forte aceleração de GPU.

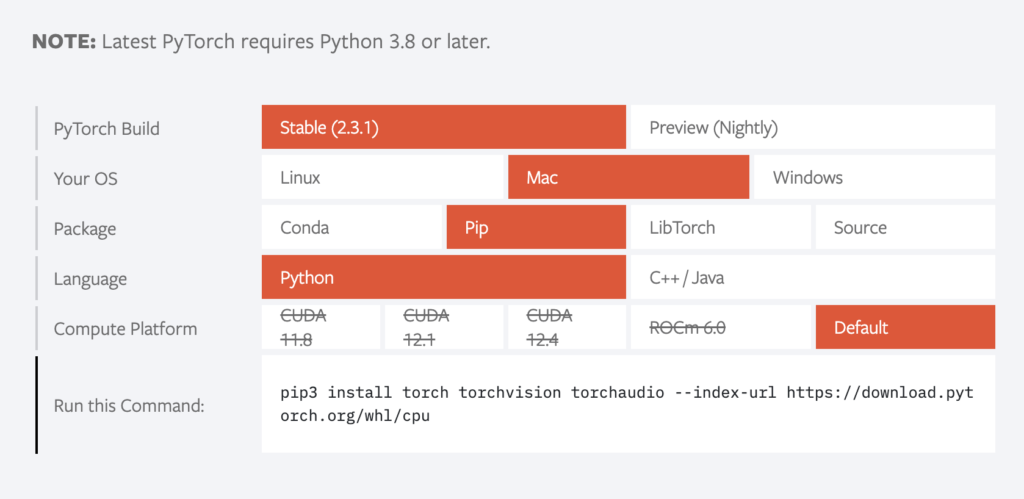

Configure e instale o PyTorch de acordo com seu sistema no site oficial PyTorch. No site, você pode configurar o comando de instalação específico para o seu sistema. Por exemplo, para um sistema Mac sem CUDA, o comando seria:

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cpu

O Modelo BLIP: Bootstrapping Language-Image Pre-training

O modelo blip-image-captioning-base é uma ferramenta poderosa para gerar legendas a partir de imagens. Desenvolvido pela Salesforce, o BLIP (Bootstrapping Language-Image Pre-training) é um novo framework de pré-treinamento de visão-linguagem que se adapta tanto a tarefas de entendimento quanto de geração de visão-linguagem.

Mais informações e uso do modelo estão disponíveis na página oficial do BLIP na Hugging Face.

O Código Completo

1. Importando Bibliotecas Necessárias

Começamos importando as bibliotecas que serão usadas no nosso script.

from transformers import pipeline

from dotenv import load_dotenv

from os import getenv

from langchain_core.prompts import PromptTemplate

from langchain_openai import OpenAI

from gtts import gTTS

2. Carregando a Chave de API

Utilizamos a biblioteca dotenv para carregar as variáveis de ambiente, garantindo que nossa chave de API esteja segura.

load_dotenv()

OPENAI_API_KEY = getenv("OPENAI_API_KEY")

3. Função para gerar texto de imagem

Como transformar imagens em histórias com IA?

A análise de imagens é realizada usando modelos de visão computacional, como o Salesforce/blip-image-captioning-base. Este modelo é capaz de interpretar o conteúdo visual da imagem e gerar uma descrição textual detalhada. Para saber mais sobre a plataforma Hugging Face, recomendo a leitura do meu artigo Explorando a Plataforma Hugging Face.

def img_to_text(img):

# Gerando texto da imagem

nlp = pipeline("image-to-text", model="Salesforce/blip-image-captioning-base")

text = nlp(img, max_new_tokens=100)[0]["generated_text"]

return text

4. Função para Criar uma História

Com o texto extraído, utilizamos a API da OpenAI para gerar uma história curta e intrigante.

def create_story(text):

# Criando a história

template = """

Você é um especialista em criar histórias intrigantes.

Crie uma história curta que tenha no máximo 20 palavras. A história deve ser intrigante e deixar o leitor curioso.

CONTEXT: {text}

"""

prompt = PromptTemplate.from_template(template)

llm = OpenAI(temperature=1)

llm_chain = prompt | llm

story = llm_chain.invoke(text)

return story

5. Função para Converter Texto em Áudio

A biblioteca gTTS (Google Text-to-Speech) é uma ferramenta poderosa para converter texto em fala. Ela usa a API do Google para gerar áudio a partir de texto, suportando vários idiomas e permitindo a criação de áudio de alta qualidade.

Benefícios do gTTS

•Acessibilidade: Facilita a criação de conteúdo de áudio para pessoas com deficiência visual.

•Multilinguismo: Suporta vários idiomas, permitindo a criação de áudio em diferentes línguas.

•Qualidade: Gera áudio de alta qualidade utilizando a tecnologia de síntese de fala do Google.

def text_to_audio(text):

# Gerando audio de texto

tts = gTTS(text, lang="pt-br")

tts.save("audio.mp3")

6. Função Principal

A função principal coordena todo o processo: da imagem ao áudio.

if __name__ == "__main__":

# Função principal do script

text = img_to_text("img.jpg")

story = create_story(text)

text_to_audio(story)

Quais são os benefícios de utilizar IA na criação de narrativas sonoras?

Os benefícios incluem:

•Eficiência: Automatiza a criação de conteúdo narrativo a partir de imagens.

•Criatividade: Gera histórias únicas e personalizadas que podem ser usadas em diversas aplicações.

•Acessibilidade: Converte texto em áudio, tornando o conteúdo acessível a mais pessoas.

Quais são os possíveis usos e aplicações da criação de narrativas sonoras com IA?

Os possíveis usos incluem:

•Educação: Criar histórias educativas baseadas em imagens históricas ou científicas.

•Marketing: Gerar conteúdo de áudio atrativo para campanhas publicitárias.

•Entretenimento: Desenvolver audiolivros ou podcasts baseados em imagens enviadas pelos usuários.

Neste artigo, demonstramos como integrar várias bibliotecas de IA para criar uma narrativa sonora a partir de uma imagem. Usamos o modelo de visão computacional da Hugging Face para extrair texto de uma imagem, a API da OpenAI para gerar uma história curta e a gTTS para converter a história em áudio. Esse processo pode ser adaptado e expandido para diversas aplicações criativas, desde projetos educacionais até entretenimento.

Sinta-se à vontade para testar e modificar o código para atender às suas necessidades específicas. Deixe seus comentários e compartilhe suas experiências!

Você pode encontrar o código completo deste projeto no nosso repositório do GitHub: Image-to-Story.